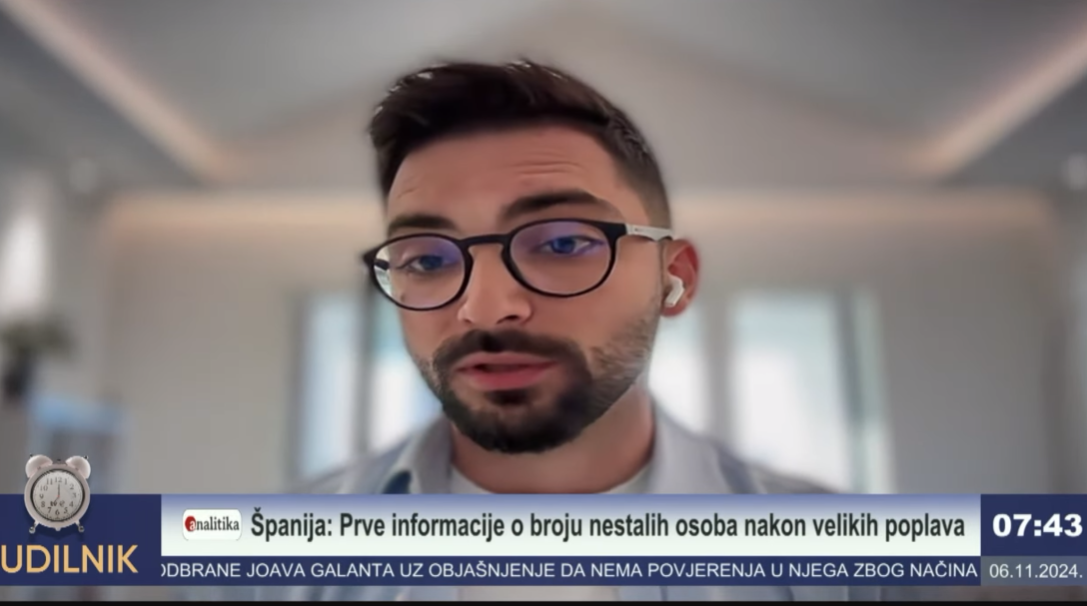

Džakula za portal Standard ističe da praksa pokazuje kako građani Crne Gore suštinski ne razumiju ulogu vještačke inteligencije, dok podaci ukazuju na njihovu ranjivost na napade.

Takođe napominje i da je Crna Gora, kao zemlja kandidat za EU članstvo, dužna da uskladi svoje zakonodavstvo sa AI Act-om.

STANDARD: Prošao je dovoljan vremenski period u kom je AI u centru pažnje. Smatrate li da je šira javnost dovoljno razumjela ulogu AI-ja?

DŽAKULA: Kratak odgovor je ne, i to me istinski brine. U Crnoj Gori danas imamo oko 472 hiljade aktivnih korisnika društvenih mreža, što je praktično cjelokupno stanovništvo koje je na mreži. Veliki broj tih ljudi svakodnevno koristi neki oblik vještačke inteligencije kroz ChatGPT, kroz algoritme TikTok-a i Instagram-a, kroz filtere i alate za generisanje slika. Ali ,,koristiti” i ,,razumjeti” su dvije potpuno različite stvari.

Ono što vidim u praksi, i kada razgovaram sa klijentima u Crnoj Gori i regionu, i kada držim predavanja, jeste da se javnost uglavnom kreće između dvije krajnosti. Na jednoj strani su oni koji AI doživljavaju kao magiju i nešto što uvijek govori istinu, nešto čemu slijepo vjeruju, čak i kada im alat izmisli činjenicu, citat ili ime. Na drugoj strani su oni koji AI doživljavaju kao prijetnju iz naučnofantastičnih filmova i nešto od čega treba bježati. Oba pristupa su pogrešna i oba su posljedica istog problema, a to je nedostatak osnovne digitalne i AI pismenosti.

Vještačka inteligencija nije magija, niti je zlo, već vrlo moćan alat koji ima svoja ograničenja, svoje pristrasnosti, i svoje rizike. Problem je što smo kao društvo kritično zapostavili edukaciju i tehnologija nam je došla u ruke brže nego što smo stigli da o njoj razmislimo. Tu se stvara opasan prostor gdje ljudi donose poslovne, zdravstvene, pa i roditeljske odluke oslanjajući se na alate koje ne razumiju, bez ikakve provjere i bez kritičkog razmišljanja.

Razumijevanje načina na koji AI funkcioniše nam nesumnjivo daje prednost, a bez toga, mi nismo korisnici tehnologije već njen proizvod, jer dozvoljavamo da tehnologija oblikuje naše ponašanje, a ne da mi oblikujemo tehnologiju prema našim potrebama. I dok god ne shvatimo tu razliku, ne možemo reći da smo kao javnost sazreli za AI eru.

STANDARD: Koje su najčešće pogrešne upotrebe AI-ja?

DŽAKULA: Ovdje bih izdvojio nekoliko kategorija, od kojih su neke direktne zloupotrebe, a neke neopreznost koja postaje bezbjednosni rizik.

Što se tiče neopreznosti izdvojio bih onu koja rijetko dospijeva u naslove, a to je prekomjerno oslanjanje na AI odgovore bez verifikacije. Ljudi AI koriste da donose odluke o svom zdravlju poput savjeta za mršavljenje, brige o ljepoti, ishrani, ili alternativnoj medicini. Koriste AI da im pomogne pri odabiru proizvoda raznih namjena, pitaju AI o savjetima za mentalno zdravlje, roditeljstvo, prijateljstva i romantičnu vezu ili brak. Zatim da pišu pravne ugovore, da tumače propise, a onda se ne trude ni da provjere rezultat. AI zna da ,,halucinira”, tj. da izmišlja činjenice sa ubjedljivošću univerzitetskog profesora. Kada se na takav izlaz slijepo oslonite, vi ste prestali da budete čovjek koji razmišlja i postali ste prenosilac poruke čije porijeklo ne razumijete. Ovo se dešavalo i prije AiI tehnologija sa prenošenjem senzacionalističkih i neprovjerenih objava na društvenim mrežama, sada je taj fenomen multipliciran sa AI.

Što se tiče direktnih zloupotreba, najvidljivija su dipfejkovi (deepfake). U Crnoj Gori smo u 2025. imali slučaj gdje su prevaranti uzeli intervju poznatog crnogorskog ljekara, izmijenili ga uz pomoć AI-ja, i iskoristili za reklamiranje sumnjivog medicinskog proizvoda, i to na sajtu koji je vizuelno imitirao portal lokalne televizije, zatim je u nekoliko navrata korišten lik premijera Crne Gore i nekoliko poslanika gdje daju lažne izjave o povećanju plata i penzija, promociji kriptovaluta, i komercijalnih proizvoda. Početkom 2026. je deepfake tehnologija prouzrokovala toliko duboku podjelu u društvu da je situacija sa odbjeglim Milošem Medenicom, koji je u bjekstvu objavio nekoliko videa gdje se obraća javnosti, oformila javnu raspravu na mrežama da li se radi o deepfake videu ili ne, tj. da li se radi o stvarnom Medenici ili samo korišćenju njegovog lika uz pomoć AI. Ova situacija je jasan indikator da javnost na internetu više nema povjerenja u sadržaj koji se plasira, i ima apsolutno opravdan osnov za to. Deepfake tehnologija je napredovala do tog nivoa da se u većini slučajeva ni forenzičkom analiziom ne može utvrditi da li je video manipulisan uz pomoć AI tehnologija.

Slično deepfake-u je i kloniranje glasa i vishing prevare. Dovoljne su tri sekunde nečijeg glasa sa društvene mreže da se napravi vjerodostojna kopija tog glasa. U svijetu su zabilježeni slučajevi gdje su porodice izgubile desetine hiljada eura jer su ,,čule svoje dijete” kako zove u pomoć preko telefonskog razgovora. Italijanski ministar odbrane ove godine tj. njegov kloniran glas iskorišćen je da se od biznismena izmami skoro milion eura. Jedan od inženjera kompanije Arup izgubio je 25,5 miliona dolara jer je učestvovao na video sastanku gdje su svi, uključujući finansijskog direktora, bili osobe sa ,,nalijepljenim” licima njegovih kolega.

Tu je i AI fišing. Osamdeset dva procenta fišing mejlova danas je generisano AI-jem. Više nema gramatičkih grešaka, nespretnih rečenica, sumnjivog prevoda, ono što je nekada bio najlakši način da prepoznate prevaru, sada je iza nas. AI fišing se pravi neuporedivo brže i ima dramatično višu stopu uspjeha.

Za firme najopasnija prijetnja je Shadow AI i curenje podataka. To je kada zaposleni, bez znanja poslodavca, ubacuju povjerljive podatke, ugovore, finansijske izvještaje ili izvorni kod kompanije u javne AI alate poput ChatGPT-a. Istraživanja pokazuju da 77 odsto zaposlenih u velikim kompanijama to radi. Samsung je zabranio ChatGPT svojim inženjerima nakon što su u njega unijeli izvorni kod. A šteta od incidenata vezanih za Shadow AI je u prosjeku 670 hiljada dolara veća od standardnih curenja podataka, a to se materijalizovalo nedavno kada je veliki broj dijeljenih ChatGPT chat sesija bilo greškom indeksirano od strane Google pretraživača i time direktno dostupno javnosti.

STANDARD: Kako prevenirati posljedice nepravilnog/nebezbjednog načina upotrebe AI-ja?

DŽAKULA: Prevencija počinje od jedne jednostavne rečenice koju ponavljam na svakom predavanju: razmišljajte kritički. U AI eri, ono što vidite i što čujete u digitalnom formatu više nije automatski dokaz stvarnosti, pričam o videima, fotografijama i audio zapisima, kao i objavama, člancima i vijestima koje plasiraju profili i portali bez pokrića. Kritičko razmišljanje podrazumijeva automatsku sumnju i skepticizam ka objavama koje bude emocije straha, nevjerice, bijesa ili čak razdraženosti, te nagon ka provjeri vjerodostojsnosti tih objava kroz analizu profila/portala čak i korišćenja AI alata da za vas provjeri autentičnost objave kroz online pretragu. To je temeljna promjena u načinu na koji moramo razmišljati, i što prije je prihvatimo, to bolje.

Za građane i porodice, tri konkretna savjeta:

Prvo: dogovorite sa svojim ukućanima, djecom, roditeljima, porodičnu ,,tajnu riječ”. Ako vas neko nazove i glasom vašeg djeteta traži hitnu pomoć ili novac, tražite tu riječ. Ako je nema, prekinite i nazovite nazad na poznati broj. Ovo je najjednostavnija i najjeftinija odbrana od vishing prevara, a može vam sačuvati hiljade eura i mnogo živaca.

Drugo: uvijek provjerite drugim kanalom. Ako vam dođe mejl ili poruka od šefa, kolege ili banke da hitno prebacite novac ili pošaljete podatke, stanite. Nazovite ili pošaljite poruku na poznati broj te ustanove ili osobe. Hitnost je uvijek crveni alarm i prevaranti vas guraju da ne stignete da razmislite.

Treće: ne ubacujte lične podatke, lozinke, finansijske informacije, medicinske nalaze ili povjerljive poslovne podatke u javne AI alate. Sve što tamo unesete može ostati u sistemu, biti iskorišćeno za treniranje modela, ili u najgorem slučaju procuriti u javnost. Ako već koristite AI, koristite plaćene verzije sa jasnim politikama privatnosti i opcijama za kontrolu vaših podataka kao zabrana treniranja modela na vašim podacima, striktne kontrole dijeljenja i pristupa.

Za kompanije priča je direktnija. Evropska unija je kroz AI Act od februara ove godine uvela obavezu AI pismenosti gdje svaka kompanija koja koristi ili razvija AI sisteme mora obezbijediti da njeni zaposleni razumiju šta rade i koje su posljedice. To nije preporuka, to je zakonska obaveza koja će se ticati i crnogorskih firmi čim budemo uskladili zakonodavstvo. Uz to idu okviri poput NIST AI Risk Management Framework-a i ISO/IEC 42001 standarda, koji nude dokazane metodologije za upravljanje rizikom od AI sistema.

Praktično, svaka kompanija bi već sada trebalo da ima: jasnu Politiku prihvatljive upotrebe AI-ja koja definiše koji su alati odobreni, ograničeni ili zabranjeni; registar AI alata koji se koriste; obuku zaposlenih o Shadow AI rizicima; i princip čovjeka u petlji ,,Human-in-the-loop (HITL)” da nijedna kritična odluka (finansijska, kadrovska, bezbjednosna) ne smije biti donesena bez ljudske verifikacije.

Ali da se vratim na suštinu. Tehnologija i procesi su samo polovina priče. Ljudski faktor je i dalje najslabija karika u svakom bezbjednosnom lancu. Ulaganje u edukaciju ljudi jednako je važno kao ulaganje u opremu. Bez kritičkog razmišljanja, najskuplji sistem zaštite na svijetu je samo skupa oprema koja se ne koristi.

STANDARD: Da li je regulativni okvir u Crnoj Gori prilagođen brzim promjenama? Da li je zakone potrebno uskladiti sa evropskim (poput Zakona o AI)?

DŽAKULA: Crna Gora trenutno nema zakon o vještačkoj inteligenciji, nema usvojenu nacionalnu strategiju za AI, nema određen regulatorni organ, i nema regulatorni sandbox. Sve što se tiče AI-ja trenutno se oslanja na opšte pravne principe iz zakona koji su pisani u vrijeme kada ovi sistemi nisu bili korišteni u praksi.

Rad na nacionalnoj AI strategiji za period 2026–2030 je u toku, koordiniše ga Ministarstvo javne uprave uz podršku UNDP-a i EU, radna grupa je već održala nekoliko sastanaka. U aprilu ove godine predstavljen je i prvi crnogorski Izvještaj o spremnosti za vještačku inteligenciju (AILA). Rezultati bi trebalo svima da budu alarm: Vlada kao korisnik AI-ja ocijenjena je sa 2,4 od 5, Vlada kao omogućivač AI-ja 3,2 od 5, a etička dimenzija AI-ja samo 1,4 od 5. Taj posljednji podatak znači da gotovo da ne postoji institucionalna podrška za transparentnost, bezbjednost i odgovornost AI sistema kod nas.

Dok se to dešava, Evropska unija je otišla daleko ispred. AI Act je stupio na snagu u avgustu 2024, a od februara 2025. već važe zabrane određenih praksi poput manipulativni AI, društveni skoring, masovno skupljanje slika lica sa interneta, prepoznavanje emocija na radnom mjestu i to sa kaznama do 35 miliona eura ili sedam odsto globalnog prometa. Od avgusta 2025. važe obaveze za velike generativne modele. Od avgusta 2026. stupaju pravila za sisteme visokog rizika. Paralelno, EU je uvela i obavezu AI pismenosti za sve organizacije koje koriste ove alate.

Crna Gora je kao zemlja kandidat za EU članstvo dužna da uskladi svoje zakonodavstvo sa AI Act-om, a kao potpisnica Okvirne konvencije Savjeta Evrope o vještačkoj inteligenciji (prvog pravno obavezujućeg međunarodnog ugovora u ovoj oblasti) imamo i jasnu obavezu u pogledu zaštite ljudskih prava u digitalnom prostoru. Ali da bismo uopšte mogli da implementiramo odredbe slične AI Act-u, prvo nam treba temelj, a to je Zakon o zaštiti podataka o ličnosti koji je stvarno usklađen sa GDPR-om (naš iz 2008. godine to nije), nezavisno regulatorno tijelo, i jasne institucionalne nadležnosti.

Dakle, odgovor je nedvosmislen da usklađivanje nije opcija, već obaveza, i to obaveza koja kasni. Što duže kasnimo, to su veći rizici i pravni, i bezbjednosni, i ekonomski. Evropske kompanije neće poslovati sa Crnom Gorom ako ne znamo kako tretiramo AI sisteme, ako nemamo usklađenu zaštitu podataka, ako ne postoji subjekt kome mogu prijaviti incident.

I.K.

TEKST JE IZRAĐEN U OKVIRU PROJEKTA ,,ŠTA GRAĐANI DOBIJAJU ULASKOM CRNE GORE U EVROPSKU UNIJU“, KOJI JE PODRŽAN OD FONDA ZA PODSTICAJ MEDIJSKOG PLURALIZMA MINISTARSTVA – MINISTARSTVA KULTURE I MEDIJA CRNE GORE

Preporučeno