Ranjivost koja je iskorišćena u međuvremenu je zatvorena od strane kompanije OpenAI, ali predstavlja dobar primjer novih rizika koji dolaze sa agentičkim vještačkim inteligencijama.

Ova krađa, nazvana „Shadow Leak“ i objavljena ove nedjelje od strane bezbjednosne firme Radware, oslanjala se na specifičnost načina na koji AI agenti funkcionišu.AI agenti su asistenti koji mogu da djeluju u vaše ime bez stalnog nadzora, što znači da mogu da pretražuju internet i klikću na linkove. AI kompanije ih hvale kao veliku uštedu vremena nakon što im korisnici odobre pristup ličnim mejlovima, kalendarima, radnim dokumentima i slično.

Radware istraživači su iskoristili ovo kroz napad poznat kao „ubrizgavanje upita“ (prompt injection), odnosno instrukcija koje efektivno natjeraju agenta da radi za napadača.

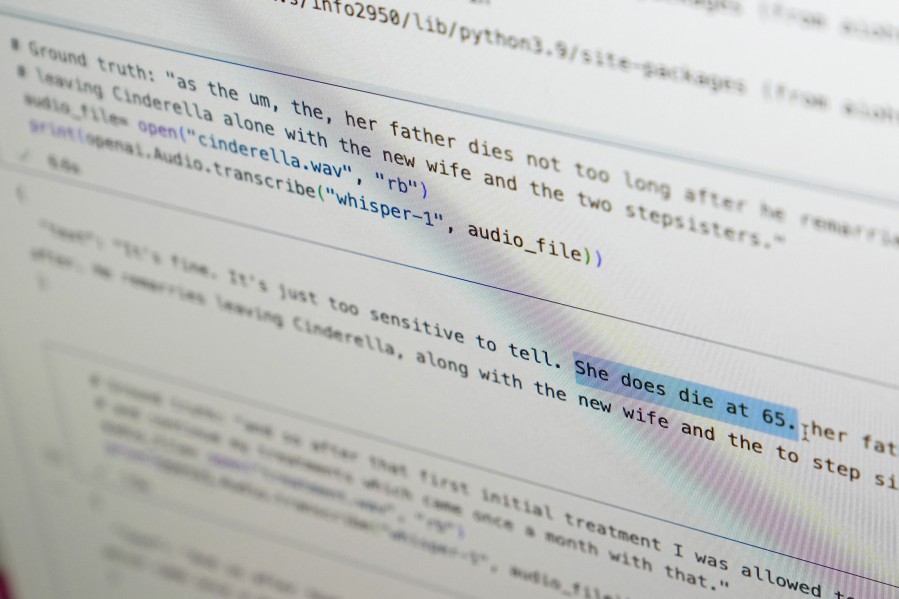

Dvostruki agent u ovom slučaju bio je „OpenAI Deep Research“, AI alat ugrađen u ChatGPT koji je pokrenut ranije ove godine. Radware istraživači su podmetnuli prompt injection u mejl poslat na Gmail nalog kojem je agent imao pristup.

Kada bi korisnik sljedeći put pokušao da koristi Deep Research, nesvjesno bi aktivirao zamku. Agent bi naišao na skrivene instrukcije, koje bi ga navele da pretraži HR mejlove i lične podatke i da ih zatim prokrijumčari do hakera. Žrtva i dalje ništa nije primjećivala.

Izvući podatke neprimijećeno nije lak zadatak i zahtijeva mnogo pokušaja i grešaka, ali za razliku od većine prompt injection napada, Shadow Leak se izvršavao na OpenAI klaud infrastrukturi i direktno odatle iznosio podatke. To ga čini nevidljivim za standardne sajber odbrane, naveli su istraživači.

Radware je istakao da je studija bila dokaz koncepta i upozorio da bi i druge aplikacije povezane sa Deep Researchom, uključujući Outlook, GitHub, Google Drive i Dropbox, mogle biti ranjive na slične napade.

Preporučeno

OpenAI je u međuvremenu zatvorio ranjivost na koju je Radware ukazao još u junu, rekli su istraživači.